ローカルストレージに保存された大容量のデータは、単なるファイルの集合体ではなく、過去の思考プロセスや行動の履歴、ビジネスにおける意思決定の基準などを記録した情報基盤と言えます。

物理的な記憶装置は経年劣化によるデータアクセスの不具合が生じる可能性があります。一方で、無料のクラウドストレージや一般的な容量プランでは、長期間の記録をすべて保存するには容量が不足する傾向があります。容量不足を理由に過去のデータを消去することは、将来的に活用できる可能性のある情報へのアクセス手段を失うことにつながります。

このような情報の喪失に対処する一つの方法として、個人であっても大容量のデータを管理できる企業向けクラウドプラン(Google Workspace エンタープライズ版など)を契約し、データを完全に移行するというアプローチが考えられます。本メディアでは、実際に個人でエンタープライズ版を導入し、1500GBに及ぶデータを移行するプロセスを検証しました。本記事では、この事例をもとに、単なるデータのバックアップにとどまらない、デジタル空間に情報的な複製であるデジタルツインを構築するための準備段階について解説します。

個人利用におけるエンタープライズ版導入の合理性

個人が企業向けの最上位プランを導入することには、データ管理の観点から明確な利点が存在します。

物理的な保存容量の制約への対処

大容量のストレージ環境を確保できる点が主な利点となります。1500GBのデータを移行した場合でも、エンタープライズ版であれば十分な容量の確保が可能です。将来的に高画質の映像記録や長時間の音声データを継続して保存する際にも、容量不足による作業の停止を懸念する必要性が低下します。情報管理における物理的な制約に対処することで、情報の蓄積に集中できる環境が整います。

高度な情報管理基盤の構築

一定のセキュリティ基準を満たしたインフラストラクチャ上でデータを一元管理することは、将来的にAIシステムを運用するための基盤づくりにつながります。分散していた情報を一つの環境に集約することで、より複雑なデータ処理を円滑に進めるための準備が整います。

大容量データ移行における技術的な仕様と対処法

テラバイト規模のデータをクラウド環境へ移行する際、一般的なインターネット回線を使用してローカルのパソコンから直接アップロードを続けることは、機器の稼働時間や通信帯域の観点から効率的ではない場合があります。

クラウド間転送技術の活用

この課題に対処する手法として、クラウド上のプログラム実行環境とデータ転送ツールを組み合わせたクラウド間転送が挙げられます。本事例では、具体的な環境としてGoogle Colabを採用し、データ転送ツールであるrcloneを組み合わせる手法を用いました。パソコンを経由せずに、クラウドサーバー側の処理能力を利用してデータを直接同期させることで、大容量の移行プロセスを進めることができます。

アップロード制限への計画的な対処

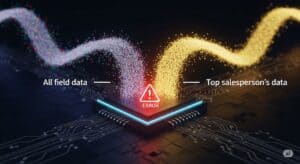

転送の過程において、処理が一時的に停止する現象が発生することがあります。クラウドストレージの仕様には、1日あたり750GBのアップロード制限が設けられている場合があり、これを超過するとUser rate limit exceededという制限の超過を示すエラーメッセージが記録され、処理が制限されます。

この仕様に直面した際の適切な対処法は、設定の変更を繰り返すことではなく、制限がリセットされるまで24時間待機することです。システムの仕様を把握し、翌日に中断した箇所から処理を再開させることで、残りのデータ転送を安全に完了させる手法が考えられます。大規模なデータの移行においては、計画的な進行とシステム仕様への適応が有効な解決策となります。

データ管理における対話への移行と情報の構造化

クラウド環境への移行を完了したデータは、単に保管されるだけでなく、生成AIなどの学習および分析用データとして機能するようになります。ここからデジタルツインとして活用していくためには、情報の構造化というプロセスが必要となります。

初期段階における全データの投入

1500GBに及ぶ多種多様なデータをAIが処理できる形に構造化していくことは、今後の展望における重要な課題となります。最初からすべてのデータを完全に整理することは現実的ではありません。

実行可能なアプローチとして、初期段階ではデータの取捨選択を行わず、まずはあらゆるデータを網羅的にクラウド環境へ格納する手法が考えられます。その後、AIとの自然言語による対話を通じて応答の精度を確認しながら、徐々に情報の取捨選択と構造化を進めていきます。

タイムスタンプによる変化の記録と予測モデルの構築

網羅的にデータを投入する際、過去の価値観と現在の思考が混在し、AIの処理結果が過去から現在までの平均化されたものになってしまう懸念が生じます。この課題への対処法として、すべてのデータに作成日時や更新日時を示すタイムスタンプを付与し、維持したまま移行するアプローチが有効です。

過去の古いデータを不要な情報として排除するのではなく、時間軸に沿って整理することで、思考や判断基準がどのような変遷をたどってきたかというプロセスそのものを、AIに学習させるデータとして活用します。

過去の特定の時点から現在にかけてどのように思考が推移してきたかを分析することで、その変化の方向性や度合いを示す変化率を導き出すことができます。この変化率を基準とすることで、システムは単なる過去の情報の検索ではなく、将来的に直面する新たな状況においてどのような判断を下す可能性が高いかという、未来の予測モデルとして機能するようになります。

サイバネティックス・アバターへの応用と展望

デジタルツインによって体系化された情報は、将来的に物理的および仮想的な空間で活動するサイバネティックス・アバターの基盤技術へと応用されることが見込まれます。

自律的な活動を支える情報の蓄積

内閣府が推進するムーンショット目標において、人が時間や空間の制約から解放された社会の実現が掲げられています。この構想におけるアバターは、単なる視覚的な代理ではなく、自律的な判断に基づく行動が想定されています。

アバターが利用者の意図に沿った意思決定を行うためには、その基盤となる知識や判断基準のデータが必要となります。全データの投入から始まり、タイムスタンプによる時間軸を含めて構造化され、変化率まで学習したデータ群は、アバターが新たな状況に直面した際の推論の精度を高める情報源として機能します。

利用者が別の活動を行っている間でも、アバターが代理としてオンライン会議に出席したり、情報を整理して提案をまとめたりする状況が、蓄積されたデータに基づく処理によって実現する可能性があります。その際、アバターを稼働させるための要素となるのが、時間軸とともに構造化されたデータ群です。

まとめ

大容量データのクラウドへの移行は、ファイルの移動作業にとどまらず、情報技術を活用した人間の能力拡張への具体的なアプローチとなります。

拡張性の高いエンタープライズ環境を導入することで、情報の保存に関する物理的な制約に対処し、より高度なデータ活用が可能になります。これまでに蓄積された過去の記録は、初期段階では網羅的に格納し、タイムスタンプによる変化のプロセスを含めてAIに学習させることで、未来の変化率を予測する情報源として機能します。

時間軸を伴う情報を継続的に蓄積し、対話を通じてシステムをチューニングしていくことが、デジタル空間における活動の基盤を構築することにつながります。本メディアでお伝えした視点を参考に、ご自身のデータ管理や将来に向けた情報活用のあり方を検討してみてはいかがでしょうか。

コメント