映画やSF小説で描かれてきた、自律的に判断し行動する機械が、現実の安全保障の領域に姿を現し始めています。人の生命に関わる判断を、人間の介在なしに機械が行うという事態は、遠い未来の物語ではなく、私たちが今まさに直面している課題です。テクノロジーの進化は私たちの生活を豊かにする一方で、その影響が及ぶ範囲で新たな課題を生じさせる側面もあります。

当メディア『人生とポートフォリオ』では、大きなテーマとして『ポストAI社会の人間と倫理』を探求しています。本記事は、その中の『統治と責任の未来』という小テーマに属するものであり、AI兵器という具体的な事象を通じて、テクノロジーと倫理の間に生じている重要な課題について深く考察します。

この記事を読み終えることで、AI兵器の問題が単なる技術論や軍事論ではなく、人間社会の基盤に関わる哲学的な問いであることを理解し、この問題について多角的に考察するための一助となるでしょう。

現実のものとなった「自律型致死兵器システム(LAWS)」

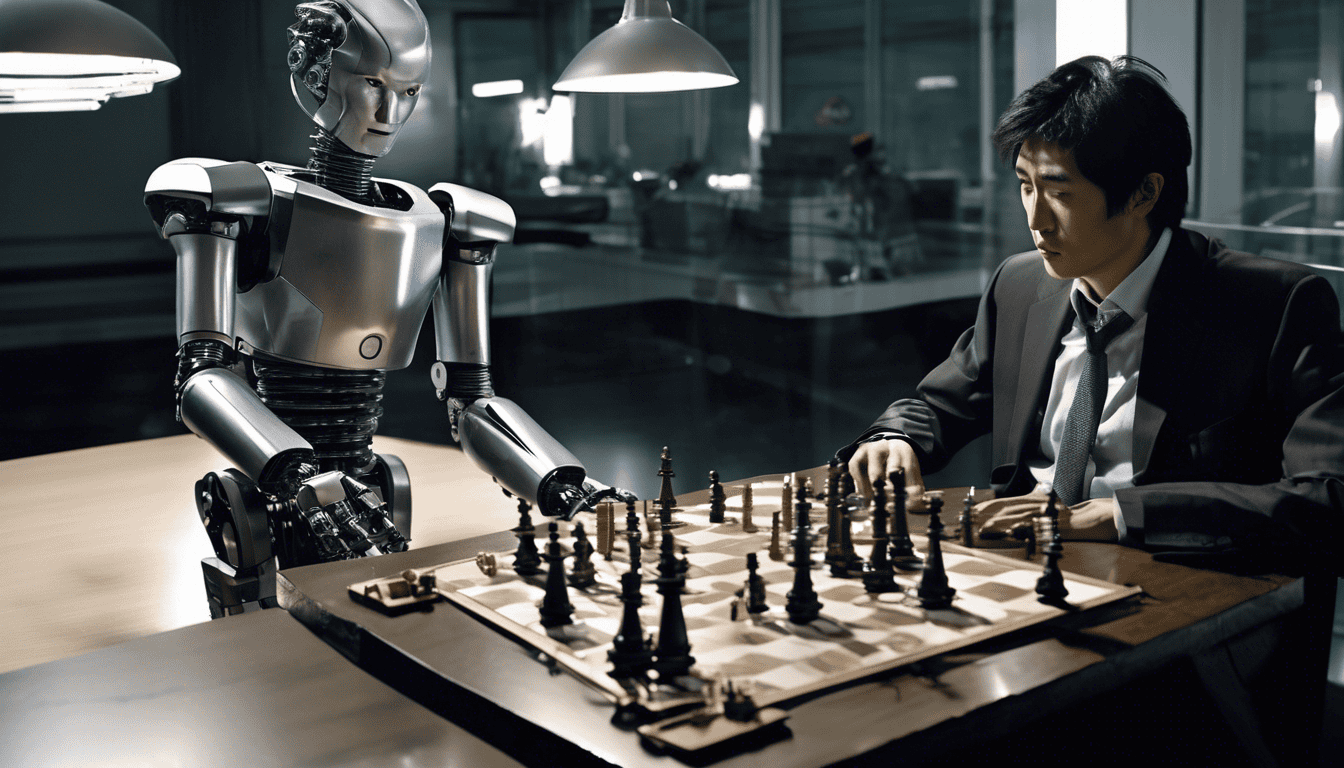

AI兵器という言葉から、人型のロボットを想像するかもしれません。しかし、現在議論の中心にあるのは、より現実的な「自律型致死兵器システム(Lethal Autonomous Weapons Systems)」、通称LAWSです。

LAWSとは何か:人間の介在を必要としないシステム

LAWSとは、標的の探索、特定、そして攻撃という一連のプロセスを、人間の直接的なコントロールなしに、AIが自律的に実行する兵器システムを指します。重要なのは「人間の介在」のレベルです。従来の遠隔操作ドローンは、最終的な攻撃の判断を人間が行う「人間参加型(Human-in-the-loop)」でした。それに対しLAWSは、人間が設定した大まかなルールに基づき、機械自身が状況を判断して行動する「人間監督型(Human-on-the-loop)」、あるいは一切の介在を許さない「完全自律型(Human-out-of-the-loop)」の段階に至る可能性があります。

開発はどこまで進んでいるのか

特定の国家や企業がどのレベルの技術を保有しているか、その全貌は安全保障上の理由から明らかにされていません。しかし、複数の報告によれば、標的を自動で追尾し、識別の補助を行うシステムはすでに実用化されています。自律的に標的を判断し、攻撃を実行する能力を持つシステムも、実験段階や限定的な運用段階にあると指摘されています。技術的な障壁は急速に低下しており、LAWSが本格的に登場するのは時間の問題であるという見方が専門家の間で共有されています。問題は「できるかどうか」ではなく、「それを許容するかどうか」という倫理的な選択の段階に移っています。

AI兵器が提起する、根源的な倫理の問い

LAWSの出現は、これまでの兵器とは次元の異なる、根源的な問いを私たちに提起します。それは技術的な課題以上に、人間社会の法体系や倫理観そのものに影響を与えるものです。

「責任の空白」:誰がその結果を引き受けるのか

LAWSが誤った判断を下し、意図せざる結果を招いた場合、その責任は誰が負うのでしょうか。AIに判断を委ねた指揮官か、そのようなAIを開発したプログラマーか、製造した企業か、あるいはその運用を許可した国家でしょうか。複雑なアルゴリズムの内部で下された判断の根拠を、人間が完全に追跡・検証することは困難です。結果として、誰も法的な責任を問うことができない「責任の空白(Accountability Gap)」が生じる可能性が指摘されています。これは、既存の国際人道法や国内法の枠組みでは想定されてこなかった事態です。

機械に「命の重み」は判断できるか

人の生命に関わる判断には、単なるデータ処理能力を超えた、極めて高度で複合的な要素が求められます。国際人道法における「区別の原則(民間人と戦闘員を区別すること)」や「比例性の原則(軍事的利益と付随的損害のバランスを考慮すること)」は、その場の文脈や相手の意図、文化的背景などを深く理解して初めて実践できるものです。AIは膨大なデータを基にパターンを認識することはできても、人間が持つ「良識」や「共感」、そして「命の重み」を理解することはできません。プログラムされたルールに従うだけの機械に、人間社会が長い年月をかけて築き上げてきた倫理的な規範を遵守させることは、果たして可能なのでしょうか。

アルゴリズムに内在するバイアスの問題

AIの判断は、学習に用いたデータセットに大きく依存します。もしそのデータに人種、性別、宗教などに関する偏見(バイアス)が含まれていた場合、AIはその偏見を再生産し、増幅させる可能性があります。特定の集団を誤って「脅威」と認識しやすいアルゴリズムが生まれる可能性は否定できません。このような「アルゴリズミック・バイアス」は、差別をシステム化し、特定の人々を不当に危険に晒すことにつながりかねない、配慮すべき重要な倫理的課題です。

国際社会の動向:規制への道筋と課題

この事態に対し、国際社会も対応を進めています。しかし、合意形成には多くの課題が存在します。

議論の舞台:国連での協議の現状

国連では、特定通常兵器使用禁止制限条約(CCW)の枠組みで、LAWSに関する政府専門家会合(GGE)が長年にわたり開催されています。ここでは、LAWSの定義、倫理的・法的な課題、そして規制のあり方について、各国の専門家が議論を重ねています。市民社会や多くの研究者、一部の国家からは、LAWSの開発や使用を禁止する新たな国際条約の制定を求める声が上がっています。彼らは、人の生命に関わる判断を機械に委ねることは、人間の尊厳を根本から損なう行為であると主張しています。

安全保障と倫理の狭間で検討を続ける各国

一方で、AI技術の開発で先行する一部の軍事大国は、法的拘束力のある規制に対して慎重な姿勢を維持しています。彼らは、LAWSが将来の安全保障環境において決定的な優位性をもたらす可能性があると考えています。他国が開発を進める中で自国だけが開発を停止すれば、抑止力が損なわれるという「安全保障のジレンマ」が、倫理的な議論より優先される構造があります。結果として、実効性のある国際的なルール作りは進展が遅く、技術開発だけが先行していくという懸念される状況が続いています。

ポストAI社会における「統治と責任」の再設計

AI兵器と倫理の問題は、軍事という特定の領域に留まりません。これは、当メディアが追求する『ポストAI社会の人間と倫理』というテーマの核心であり、これからの社会における「統治と責任」のあり方を根本から問い直すものです。

テクノロジーの進化と倫理観の非対称性

私たちは今、テクノロジーの指数関数的な進化と、人間の倫理観や社会制度の直線的な進化という「非対称性」の中にいます。AIがもたらす変化の速度に、私たちの社会が適応する速度が追いついていないのです。このギャップを埋めるための議論が十分に行われない場合、AIは人間の意図を超えて、社会に予測不能な影響を及ぼす可能性があります。LAWSの問題は、その顕著な一例と言えるでしょう。

私たち市民に求められる役割とは

この問題は、専門家や政策決定者だけの課題ではありません。なぜなら、これは「人間とは何か」「人間社会が守るべき一線はどこか」という、私たち全員に関わる問いだからです。重要なのは、この問題を自分たちの社会の問題として捉え、関心を持ち続けることです。テクノロジーの方向性を健全に導くのは、さらなるテクノロジーではなく、人間社会の集合的な意思と倫理観です。私たちがこの問題について学び、考え、議論を深めることこそが、未来の「統治と責任」の形を設計していく上で重要なプロセスです。

まとめ

人間の介在なしに、機械が自律的に人の生命に関わる判断を下すAI兵器、すなわちLAWSの開発は、すでに現実の課題となっています。その存在は、責任の所在が曖昧になる「責任の空白」、機械には判断できない「命の重み」、そしてアルゴリズムに内在する「バイアス」といった、重大な倫理的・法的な問題を提起しています。国際社会は規制に向けた議論を続けていますが、各国の安全保障上の利害が絡み合い、実効性のあるルール作りは進んでいません。

この問題は、テクノロジーの進化速度に社会の倫理観が追いついていない現状を象徴しています。これは、ポストAI社会を生きる私たち全員が向き合うべき「統治と責任」の課題です。この記事が、あなたがこの複雑で重要な問題について関心を持ち、自分なりの意見を形成していくための一助となれば幸いです。未来の社会は、現在の私たちの選択によって方向付けられていくのかもしれません。

コメント